Appearance

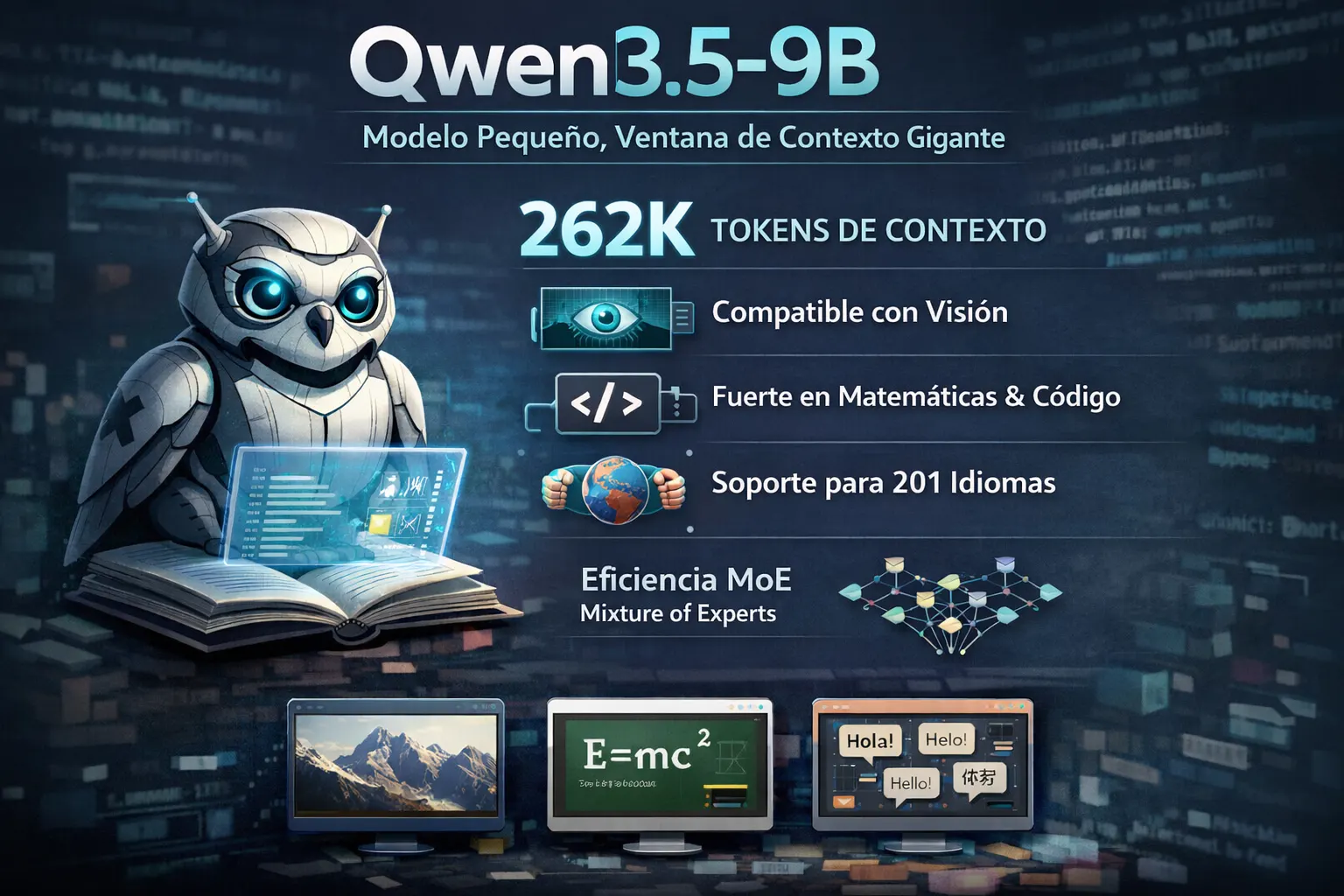

Qwen3.5-9B: un modelo compacto con una ventana de contexto masiva

Un modelo pequeño que juega en ligas mayores

Durante los últimos meses hemos visto una tendencia clara: los modelos de lenguaje más interesantes ya no son necesariamente los más grandes. Lo que importa es la arquitectura, el entrenamiento y la eficiencia. Qwen3.5-9B es la prueba más reciente de esta filosofía. Con solo 9 mil millones de parámetros, este modelo del equipo Qwen ofrece capacidades que hace un año solo veíamos en modelos diez veces mayores.

La idea clave

Qwen3.5-9B combina una arquitectura híbrida de Gated Delta Networks con capas dispersas de Mixture-of-Experts (MoE), logrando alta velocidad de inferencia con baja latencia y una ventana de contexto nativa de 262.144 tokens, ampliable a más de un millón.

Si has seguido la evolución de los modelos eficientes — como analizamos en Más grande ya no escala: activar solo lo necesario — Qwen3.5-9B encaja perfectamente en esa tendencia: no se trata de añadir más parámetros, sino de activar solo los que se necesitan en cada momento.

Arquitectura híbrida: Gated Delta Networks + MoE disperso

Lo que diferencia a Qwen3.5-9B de otros modelos compactos es su arquitectura en dos niveles:

Gated Delta Networks

Las Gated Delta Networks son una variante de las redes recurrentes lineales que permiten al modelo procesar secuencias extremadamente largas sin el coste cuadrático de la atención completa. En lugar de calcular la atención entre todos los tokens simultáneamente, el mecanismo Delta actualiza incrementalmente una representación comprimida de la secuencia, haciendo que el coste sea prácticamente lineal con la longitud de entrada.

Mixture-of-Experts disperso

El modelo incorpora capas MoE dispersas donde solo un subconjunto de los "expertos" (subredes especializadas) se activa para cada token. Esto significa que, aunque el modelo tiene acceso a una gran cantidad de conocimiento especializado, el coste computacional por token es significativamente menor que el de un modelo denso equivalente.

Combinación estratégica

La combinación de ambas técnicas permite que Qwen3.5-9B procese contextos enormes de forma eficiente: las Gated Delta Networks manejan la longitud de la secuencia, mientras que el MoE disperso mantiene bajo el coste por token.

Esta filosofía de diseño es la misma que impulsa avances como la compactación rápida del KV-Cache mediante attention matching: optimizar la memoria y el cómputo sin sacrificar la calidad de las respuestas.

Una ventana de contexto de otro nivel

Uno de los aspectos más impresionantes de Qwen3.5-9B es su ventana de contexto. El modelo soporta nativamente 262.144 tokens — más que suficiente para procesar documentos técnicos extensos, conversaciones largas o bases de código completas. Pero lo realmente sorprendente es que puede extenderse hasta 1.010.000 tokens con las configuraciones adecuadas.

Para ponerlo en perspectiva:

| Modelo | Contexto nativo | Contexto extendido |

|---|---|---|

| GPT-4o | 128K tokens | — |

| Claude 3.5 Sonnet | 200K tokens | — |

| Qwen3.5-9B | 262K tokens | 1.01M tokens |

| Gemini 1.5 Pro | 1M tokens | 2M tokens |

Como exploramos en El mito del contexto infinito, tener una ventana de contexto grande no es lo mismo que usarla bien. Lo que distingue a Qwen3.5-9B es que su arquitectura híbrida está diseñada específicamente para mantener la coherencia a lo largo de secuencias extremadamente largas, a diferencia de modelos que simplemente amplían su ventana sin adaptar la arquitectura subyacente.

Un millón de tokens suena impresionante en el papel. La pregunta real es: ¿puede el modelo mantener la coherencia y la precisión a lo largo de toda esa extensión?

Capacidades multimodales: texto e imagen en un solo modelo

Qwen3.5-9B no se limita al texto. El modelo incluye un codificador de visión que le permite procesar y razonar sobre imágenes junto con entradas de texto. Esto lo convierte en una opción interesante para aplicaciones que necesitan entender documentos con imágenes, diagramas técnicos o interfaces visuales.

En benchmarks de tareas visuales:

- 90.1 en respuesta a preguntas visuales generales

- 97.2 en tareas de conteo, demostrando sólido razonamiento espacial

Estas capacidades multimodales, combinadas con su tamaño compacto, lo hacen especialmente útil para despliegues donde se necesita procesamiento visual sin el coste de modelos gigantes. Si te interesa el mundo multimodal, puedes profundizar en ChatGPT Multimodal para ver cómo otros modelos abordan esta capacidad.

Rendimiento en benchmarks: los números que importan

A pesar de su tamaño contenido, Qwen3.5-9B muestra resultados notables en las evaluaciones más exigentes:

| Benchmark | Puntuación | Qué mide |

|---|---|---|

| HMMT Feb 25 | 83.2 | Resolución de problemas matemáticos avanzados |

| MathVision | 78.9 | Razonamiento matemático visual |

| IFEval | 91.5 | Seguimiento preciso de instrucciones |

| VQA general | 90.1 | Comprensión visual general |

| Conteo | 97.2 | Razonamiento espacial |

El resultado en IFEval (91.5) es particularmente relevante. Para sistemas agentivos — donde el modelo debe seguir instrucciones complejas de forma precisa — esta puntuación indica que Qwen3.5-9B es fiable como motor de ejecución. Esto conecta directamente con lo que discutimos en Context Engineering: la arquitectura de la IA confiable: un modelo que sigue instrucciones de forma consistente es un componente fundamental para construir sistemas de IA robustos.

Soporte multilingüe: 201 idiomas y dialectos

Otro punto fuerte de Qwen3.5-9B es su soporte para 201 idiomas y dialectos. Esto no es simplemente traducción: el modelo tiene comprensión contextual matizada en cada uno de esos idiomas, lo que lo hace adecuado para despliegues globales sin necesidad de modelos separados por región.

Para equipos que trabajan con contenido en múltiples idiomas — desde análisis de sentimiento hasta verificación de traducciones — tener un único modelo compacto que cubra este espectro lingüístico es un avance significativo en eficiencia operativa.

Modo de pensamiento: razonamiento paso a paso

Qwen3.5-9B incluye un "modo de pensamiento" (thinking mode) que, cuando está activado, genera pasos de razonamiento intermedios antes de producir la respuesta final. Esto es útil para:

- Problemas matemáticos complejos: el modelo muestra su proceso de resolución

- Tareas de programación: descompone el problema antes de generar código

- Análisis de documentos largos: estructura su comprensión paso a paso

Consejo práctico

Si necesitas respuestas rápidas y concisas, desactiva el modo de pensamiento. El razonamiento paso a paso mejora la precisión pero aumenta la latencia y el número de tokens generados.

La familia Qwen3.5: opciones para cada necesidad

Qwen3.5-9B no existe en aislamiento. Es parte de una familia de modelos diseñada para cubrir diferentes puntos del espectro coste-rendimiento:

| Modelo | Parámetros | Caso de uso |

|---|---|---|

| Qwen3.5-9B | 9B | Despliegues eficientes, dispositivos con recursos limitados |

| Qwen3.5-27B | 27B | Mayor capacidad general |

| Qwen3.5-35B-A3B | 35B (3B activos) | Balance MoE intermedio |

| Qwen3.5-122B-A10B | 122B (10B activos) | Alta capacidad con eficiencia MoE |

La notación "A3B" y "A10B" indica los parámetros activos por token — el resto permanece inactivo gracias a la arquitectura MoE dispersa. Esto conecta con la tendencia que describimos en Más grande ya no escala: la clave no es el tamaño total del modelo, sino cuántos parámetros se activan realmente en cada paso.

Casos de uso prácticos

Procesamiento de documentos largos

Con su ventana de contexto de más de 262K tokens, Qwen3.5-9B puede ingerir documentos legales completos, papers de investigación o historiales de conversación sin necesidad de particionarlos. Esto simplifica enormemente las pipelines de procesamiento de texto.

Sistemas agentivos

Su alta puntuación en IFEval y benchmarks de uso de herramientas lo convierten en un candidato sólido para sistemas basados en agentes. Si estás construyendo pipelines agentivas, la combinación de bajo coste por token y seguimiento preciso de instrucciones es exactamente lo que necesitas. Para más contexto sobre este tipo de sistemas, revisa Sistemas Open + Claude: Agentes IA que transforman trabajo, vida y negocios.

Soporte al cliente multilingüe

Un solo modelo que entiende 201 idiomas, puede procesar imágenes adjuntas y seguir instrucciones con precisión es una base sólida para chatbots de soporte técnico globales.

Herramientas educativas

La combinación de razonamiento matemático fuerte (83.2 en HMMT), modo de pensamiento paso a paso y capacidades visuales lo hace ideal para tutorías automatizadas y asistencia con tareas.

Conclusión: la eficiencia como ventaja competitiva

Qwen3.5-9B representa un paso más en la dirección que la industria de la IA está tomando: modelos más pequeños, más inteligentes y más especializados. Su arquitectura híbrida demuestra que no hace falta escalar brutalmente los parámetros para obtener resultados competitivos. La combinación de Gated Delta Networks para manejar contextos largos y MoE disperso para mantener la eficiencia por token es una solución elegante a dos de los problemas más persistentes de los LLMs actuales.

Para desarrolladores y organizaciones que buscan desplegar modelos potentes sin los costes asociados a modelos masivos, Qwen3.5-9B es una opción que merece seria consideración. Y con una ventana de contexto que supera el millón de tokens, las limitaciones prácticas de longitud de entrada dejan de ser un problema para la mayoría de los casos de uso reales.

Fuente: Qwen3.5-9B en Hugging Face | AIModels.fyi