Appearance

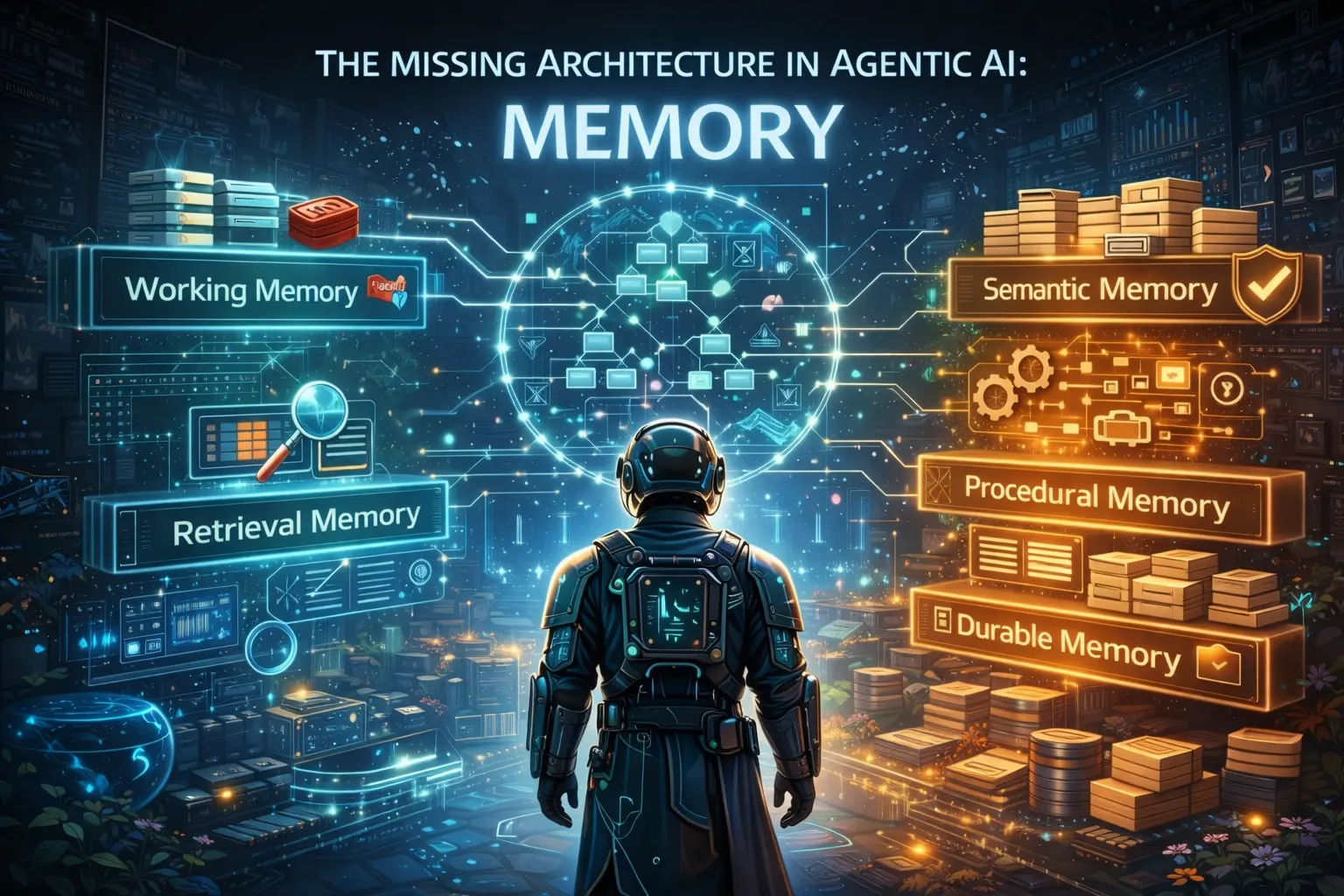

La Arquitectura Ausente en la IA Agentiva: la Memoria

Más de dos décadas diseñando sistemas empresariales. SOA, cloud, big data, microservicios, DevOps — cada ola prometía transformación.

La mayoría no fracasó porque la tecnología fuera inmadura. Fracasó porque la arquitectura subyacente no estaba completamente pensada.

Estamos en un momento similar con la IA agentiva.

El enfoque equivocado

Ahora mismo, la conversación gira alrededor de modelos, prompts, frameworks de orquestación y llamadas a herramientas. Todo eso importa. Pero no es el desafío central.

El verdadero desafío es la memoria.

Si no has diseñado cómo recuerda tu agente, no has diseñado el sistema.

Los LLM no recuerdan. Procesan el contexto que les proporcionas. Sin capas de memoria externa deliberadas, los agentes olvidan interacciones previas, aplican mal las políticas, pierden el estado del flujo de trabajo y se comportan de manera inconsistente entre sesiones.

Eso puede ser tolerable en un prototipo. En un entorno empresarial, es inaceptable.

El espejismo del contexto

Como ya exploramos en El mito del contexto infinito, meter más tokens en la ventana de contexto no equivale a más memoria. El fenómeno "Lost in the Middle" demuestra que la atención se degrada dramáticamente en el centro del contexto. Más datos no significan mejor recuerdo — significan más ruido.

Las cinco capas de memoria que importan

En sistemas de producción, la memoria no es una capacidad única. Es una arquitectura por capas, donde cada capa cumple un propósito distinto.

1. Memoria de Trabajo (Working Memory)

Contexto de corta duración, vinculado a la sesión, optimizado para velocidad y baja latencia. Normalmente implementado con sistemas en memoria como Redis.

Esta capa garantiza continuidad conversacional — no inteligencia a largo plazo.

┌─────────────────────────────────────┐

│ MEMORIA DE TRABAJO │

├─────────────────────────────────────┤

│ Sesión activa del usuario │

│ Historial inmediato de diálogo │

│ Variables temporales del flujo │

│ Estado actual de la tarea │

├─────────────────────────────────────┤

│ TTL: minutos a horas │

│ Backend: Redis / In-memory cache │

│ Latencia objetivo: < 10ms │

└─────────────────────────────────────┘Es el equivalente a lo que tú y yo mantenemos en mente durante una conversación: el hilo inmediato. Sin ella, cada mensaje del agente empieza desde cero.

2. Memoria de Recuperación (Retrieval Memory)

Recuperación de conocimiento basada en vectores que permite al agente buscar contenido empresarial relevante en tiempo de ejecución.

Esta capa reduce las alucinaciones, pero por sí sola no crea comprensión.

┌─────────────────────────────────────┐

│ MEMORIA DE RECUPERACIÓN │

├─────────────────────────────────────┤

│ Documentos de política interna │

│ Base de conocimiento │

│ FAQs, manuales, procedimientos │

│ Datos indexados semánticamente │

├─────────────────────────────────────┤

│ Backend: pgvector / Pinecone / │

│ Qdrant / Weaviate │

│ Latencia objetivo: < 200ms │

└─────────────────────────────────────┘Es lo que en la industria se conoce como RAG (Retrieval-Augmented Generation). Pero un RAG sin las demás capas es solo una búsqueda glorificada. Como describimos en Context Engineering: La Arquitectura de la IA Confiable, la clave no es cuánto recuperas, sino cómo curas ese contexto antes de inyectarlo al modelo.

3. Memoria Semántica (Semantic Memory)

Representación estructurada de las relaciones empresariales: jerarquías organizacionales, taxonomías de productos, mapeos de cumplimiento normativo.

Esta capa le da al agente conciencia contextual de cómo se conectan las cosas.

┌─────────────────────────────────────┐

│ MEMORIA SEMÁNTICA │

├─────────────────────────────────────┤

│ Grafos de conocimiento │

│ Ontologías empresariales │

│ Relaciones entre entidades │

│ Taxonomías y jerarquías │

├─────────────────────────────────────┤

│ Backend: Neo4j / Amazon Neptune / │

│ Apache Jena │

│ Consultas: Cypher / SPARQL │

└─────────────────────────────────────┘Sin memoria semántica, un agente puede encontrar un documento sobre "política de vacaciones", pero no sabe que el empleado que pregunta pertenece a una filial con un convenio diferente. Los Modelos Recursivos de Lenguaje (RLM) apuntan precisamente a esta dirección: externalizar el razonamiento estructurado en entornos programables.

4. Memoria Procedimental (Procedural Memory)

Estado de flujo de trabajo y ejecución. Así es como el agente recuerda cómo actuar, no solo qué decir. Incluye lógica de orquestación, coordinación de herramientas y flujos multi-agente.

┌─────────────────────────────────────┐

│ MEMORIA PROCEDIMENTAL │

├─────────────────────────────────────┤

│ Estado de workflow activo │

│ Pasos completados / pendientes │

│ Coordinación entre agentes │

│ Lógica de herramientas │

├─────────────────────────────────────┤

│ Backend: Temporal / Apache Airflow │

│ / State machines │

│ Persistencia: durable + replay │

└─────────────────────────────────────┘Esta es la capa que separa a un chatbot de un agente verdaderamente autónomo. Como analizamos en Cómo los sistemas de agentes IA estilo 'Open-Claude' están transformando el trabajo, los agentes que operan de forma continua necesitan mantener el estado de ejecución a través del tiempo — no solo responder preguntas, sino completar procesos.

5. Memoria Durable (Durable Memory)

Registros de auditoría persistentes, logs de eventos e historial de decisiones. Esta capa habilita la explicabilidad, el cumplimiento normativo, la trazabilidad y la mejora continua.

┌─────────────────────────────────────┐

│ MEMORIA DURABLE │

├─────────────────────────────────────┤

│ Logs de decisiones del agente │

│ Auditoría de acciones ejecutadas │

│ Historial de interacciones │

│ Métricas de rendimiento │

├─────────────────────────────────────┤

│ Backend: PostgreSQL / Event Store │

│ / Data Lake (S3 + Parquet)│

│ Retención: meses a años │

│ Inmutable: append-only │

└─────────────────────────────────────┘Sin esta capa, no hay forma de responder la pregunta más importante en un entorno regulado: "¿Por qué el agente hizo esto?"

El error más común: colapsar todo en un solo almacén

La mayoría de los equipos comprimen estas cinco capas en un único almacén: una base de datos vectorial, una caché o una colección de documentos.

Eso no es arquitectura. Es conveniencia.

| Capa | Requisito principal | Riesgo si se mezcla |

|---|---|---|

| Trabajo | Velocidad extrema (< 10ms) | Latencia en respuestas conversacionales |

| Recuperación | Relevancia semántica | Alucinaciones por ruido contextual |

| Semántica | Estructura relacional | Pérdida de conexiones entre entidades |

| Procedimental | Durabilidad de estado | Flujos interrumpidos sin recuperación |

| Durable | Inmutabilidad y trazabilidad | Imposibilidad de auditoría |

Los sistemas maduros separan responsabilidades porque velocidad, anclaje, estructura, ejecución y gobernanza tienen requisitos de rendimiento y riesgo diferentes.

Analogía con microservicios

Así como aprendimos (a veces por las malas) que un monolito no escala cuando cada módulo tiene requisitos distintos de latencia, disponibilidad y escalabilidad, la memoria de un agente necesita la misma separación de responsabilidades. La diferencia es que aquí el "módulo" no es código — es conocimiento.

Cuando la memoria se convierte en infraestructura de gobernanza

Cuando los agentes empiezan a influir en resultados de negocio — aprobar reclamaciones, escalar incidencias, generar recomendaciones — la memoria deja de ser un detalle técnico de implementación. Se convierte en infraestructura de gobernanza.

En ese punto, los directivos deben poder responder tres preguntas críticas:

- ¿Por qué el agente tomó esta decisión?

- ¿Qué datos y estado previo la influyeron?

- ¿Dónde está eso registrado y es auditable?

Si esas respuestas no son claras, no tienes IA empresarial. Tienes automatización no gestionada.

Como exploramos en ¿Contratarías a un mayordomo hipnotizable?, un agente con acceso a correo, documentos y herramientas no es un buscador: es un empleado con llaves. Y todo empleado necesita un registro de sus acciones, especialmente cuando esas acciones son irreversibles.

El cambio de conversación necesario

Las organizaciones que lideren en IA agentiva no necesariamente tendrán los modelos más grandes. Tendrán las arquitecturas de memoria más disciplinadas — por capas, observables, gobernadas y alineadas con marcos de riesgo empresarial.

La conversación necesita cambiar:

No: "¿Qué modelo estamos usando?"

Sino: "¿Cómo recuerda nuestra IA — y cómo controlamos esa memoria?"

Ahí es donde empieza la arquitectura real.

Visión completa: las cinco capas en acción

┌──────────────────┐

Usuario ───────►│ MEMORIA DE │

│ TRABAJO (Redis) │◄── Sesión activa

└────────┬─────────┘

│

┌────────▼─────────┐

│ MEMORIA DE │

│ RECUPERACIÓN │◄── Documentos, FAQs

│ (Vector DB) │

└────────┬─────────┘

│

┌────────▼─────────┐

│ MEMORIA │

│ SEMÁNTICA │◄── Grafos, relaciones

│ (Knowledge Graph)│

└────────┬─────────┘

│

┌────────▼─────────┐

│ MEMORIA │

│ PROCEDIMENTAL │◄── Workflows, estado

│ (Temporal/State) │

└────────┬─────────┘

│

┌────────▼─────────┐

│ MEMORIA │

│ DURABLE │◄── Auditoría, logs

│ (Event Store/DB) │

└─────────────────┘Referencia práctica: implementación de código abierto

Para quienes quieran ver este modelo en acción, existe una implementación de referencia en GitHub que demuestra las capas de memoria centrales utilizadas en sistemas de IA agentiva de grado empresarial:

- Memoria de trabajo (contexto de sesión)

- Memoria de recuperación (búsqueda vectorial)

- Memoria semántica (grafo de conocimiento)

- Memoria procedimental (orquestación de flujos)

- Memoria durable (registro de auditoría)

Caso de uso implementado: Asistente de Políticas de RRHH

Un asistente empresarial que:

- Recupera documentos de política interna

- Comprende relaciones organizacionales

- Ejecuta lógica de flujo de trabajo

- Mantiene continuidad de sesión

- Registra decisiones para auditoría y cumplimiento

Explora la implementación: Enterprise Agentic AI Memory Lab en GitHub

Conclusión

La memoria no es solo almacenamiento. Es cómo los agentes mantienen continuidad, anclaje, estructura, estado de ejecución y rendición de cuentas.

Las piezas del rompecabezas ya están ahí: la ingeniería de contexto nos enseña a curar la información, la compactación del KV Cache hace viables los contextos largos, y los modelos recursivos externalizan el razonamiento. Lo que falta es unir todo en una arquitectura coherente por capas.

La próxima vez que evalúes un sistema de IA agentiva, no preguntes cuántos parámetros tiene el modelo. Pregunta:

¿Cómo recuerda? ¿Y quién controla esa memoria?

Fuentes y referencias

- EagleEyeThinker — "The Missing Architecture in Agentic AI: Memory", 2026.

- Enterprise Agentic AI Memory Lab — Implementación de referencia en GitHub.