Appearance

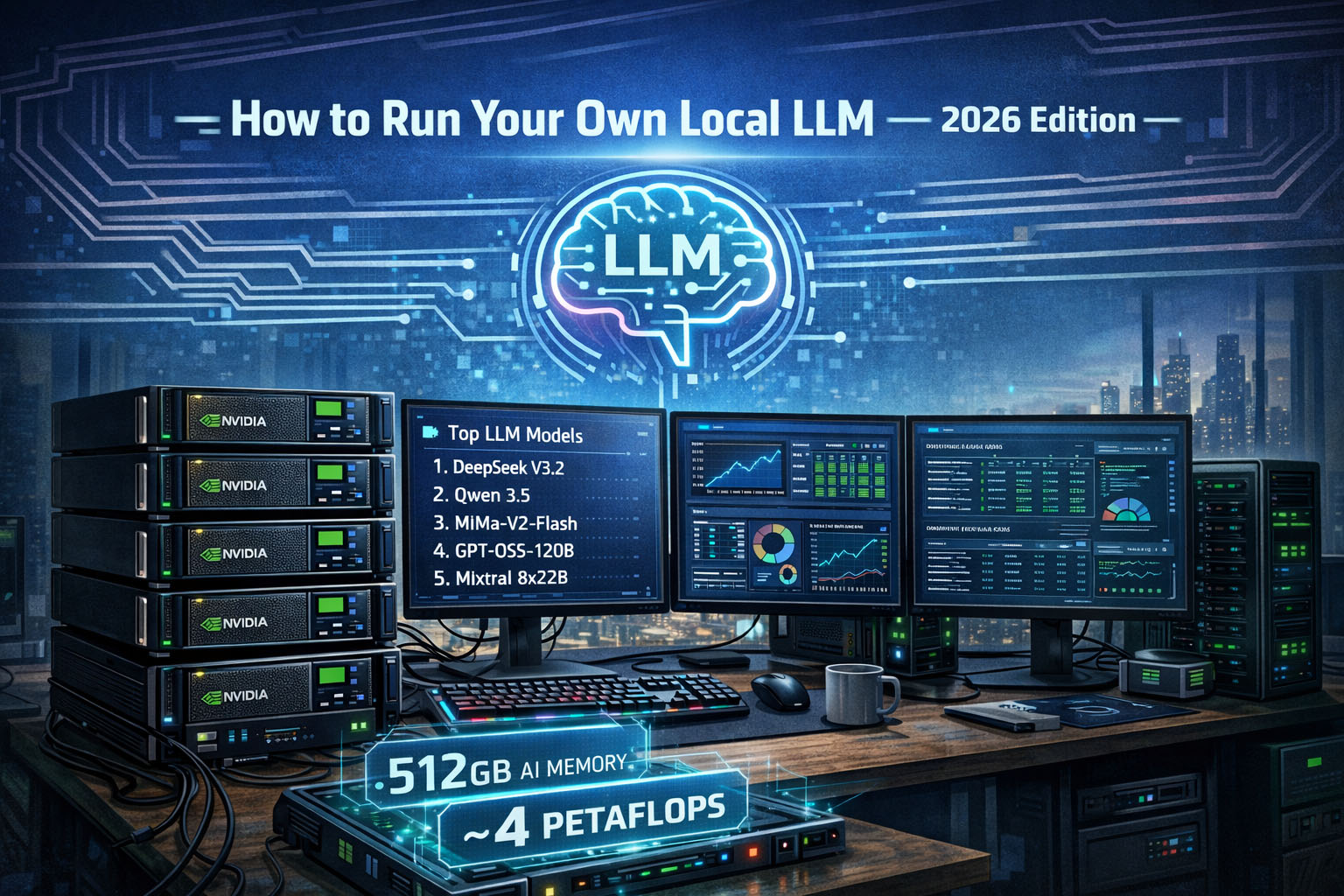

Los 10 mejores LLMs locales en Quad NVIDIA DGX Spark — Edición 2026 — Versión 1

2026: El año en que la IA local se volvió verdaderamente práctica

Estamos viviendo un cambio de paradigma fundamental en la forma en que los desarrolladores individuales y los equipos pequeños interactúan con los modelos de lenguaje de gran escala.

Durante tres años, la conversación estuvo dominada por APIs en la nube, niveles de suscripción y un puñado de guardianes que controlaban los modelos más potentes detrás de límites de tasa y términos de servicio.

El año 2026 lo ha cambiado todo.

El catalizador es el hardware.

Cuando NVIDIA envió el DGX Spark a finales de 2025 — un supercomputador de escritorio compacto construido alrededor del Superchip GB10 Grace Blackwell — puso un petaflop genuino de rendimiento de IA en FP4 y 128 GB de memoria unificada LPDDR5x en un dispositivo más pequeño que una caja de zapatos, midiendo solo 150 × 150 × 50,5 mm y pesando apenas 1,2 kg.

El DGX Station es una adición aún más potente, y lo cubriremos en la Versión 2 de este artículo, más adelante este año. Precio inicial: $36.000, ¡pero 775 GB de Memoria Unificada!

A $4.699 por unidad (DGX Spark) (a fecha del 27 de febrero de 2026, tras una revisión de precio desde los $3.999 originales debido a restricciones globales en el suministro de memoria), el DGX Spark hizo económicamente racional para startups, laboratorios de investigación e incluso aficionados serios traer modelos que anteriormente requerían nodos de centros de datos directamente a sus escritorios.

Pero la verdadera magia ocurre cuando conectas múltiples unidades.

Dos DGX Sparks enlazados a través de sus NICs inteligentes ConnectX-7 crean un pool de memoria de 256 GB capaz de ejecutar modelos de hasta 405 mil millones de parámetros.

Escala a una configuración quad-node — cuatro unidades interconectadas a través de un switch RoCE de 200 GbE de alto rendimiento — y desbloqueas 512 GB de memoria unificada y aproximadamente 4 petaflops de cómputo FP4 agregado.

Eso es más que suficiente para ejecutar los modelos frontier de peso abierto más grandes disponibles actualmente, completamente cuantizados, totalmente offline, con cero datos saliendo de tus instalaciones.

Si te interesa el impacto económico de la eficiencia en hardware de IA, no te pierdas nuestro artículo sobre la paradoja de Jevons aplicada a NVIDIA y DeepSeek.

Este artículo es un análisis técnico profundo de los diez modelos de lenguaje de gran escala con mejor rendimiento que puedes ejecutar hoy en un clúster Quad DGX Spark en forma cuantizada.

Evaluamos cada modelo en cinco ejes: rendimiento bruto en benchmarks, amigabilidad con la cuantización, capacidad de ventana de contexto, eficiencia arquitectónica y adecuación en el mundo real para flujos de trabajo agénticos y empresariales.

Luego listamos recomendaciones para la estación de trabajo de centro de mando óptima para orquestar, monitorizar y gestionar toda la configuración.

Advertencia — ejecutar LLMs localmente en producción con sistemas de codificación agéntica como OpenClaw significa que solo 5-10 desarrolladores pueden usar esto concurrentemente, con cada desarrollador usando agentes.

Si realmente quieres escalar LLMs locales, prueba el NVIDIA DGX Station.

Depurar y mantener LLMs locales en producción es una tarea enorme y he añadido 3 apéndices para más información.

Pero si quieres privacidad absoluta de datos y sistemas aislados (air-gapped), este es el camino.

Con eso en mente:

Comencemos.

La plataforma Quad DGX Spark de un vistazo

Antes de sumergirnos en los modelos, es esencial entender exactamente qué compra tu presupuesto de hardware.

| Especificación | Por nodo | Clúster Quad |

|---|---|---|

| Superchip | GB10 Grace Blackwell (co-diseñado con MediaTek) | 4× GB10 |

| GPU | Arquitectura Blackwell — 6.144 CUDA Cores, Tensor Cores 5ª Gen, RT Cores 4ª Gen | 24.576 CUDA Cores |

| Cómputo IA (FP4, sparse) | 1 PFLOP (1.000 TOPS) | ~4 PFLOPS |

| Memoria unificada | 128 GB LPDDR5x (273 GB/s ancho de banda) | 512 GB |

| CPU | 20 núcleos Arm (10× Cortex-X925 + 10× Cortex-A725) | 80 núcleos |

| Almacenamiento | Hasta 4 TB NVMe M.2 SSD (auto-cifrado) | Hasta 16 TB |

| Red | ConnectX-7 Smart NIC (hasta 200 Gbps) + 10 GbE + Wi-Fi 7 | Fabric RoCE 200 GbE |

| Conectividad | 4× USB-C, HDMI 2.1a | — |

| SO | DGX OS (basado en Ubuntu), stack NVIDIA AI preinstalado | NCCL / MPI a nivel de clúster |

| Dimensiones | 150 × 150 × 50,5 mm, 1,2 kg | — |

| Precio aprox. (Mar 2026) | $4.699 | ~$18.796 + switch |

El arma secreta del DGX Spark es su arquitectura de memoria unificada coherente.

A diferencia de las configuraciones GPU tradicionales donde la VRAM y la RAM del sistema son pools separados, el Superchip GB10 comparte la totalidad de sus 128 GB entre la GPU y la CPU.

Cuando los pesos cuantizados de un modelo necesitan residir en memoria, cada gigabyte cuenta.

Con cuatro nodos y un fabric NCCL bien configurado usando GPUDirect RDMA, puedes realizar inferencia distribuida con paralelismo de pipeline, y la interconexión RoCE de 200 GbE mantiene la latencia entre nodos lo suficientemente baja para cargas de trabajo conversacionales en tiempo real.

Para la configuración quad, necesitarás un switch gestionado de 200 GbE compatible — el NVIDIA Spectrum-2 SN3700 o el más económico Mellanox SN2201 — configurado con tramas jumbo (MTU 9000) y RoCEv2.

Presupuesta aproximadamente $2.000–$4.000 para el switch y el cableado, llevando la inversión total en hardware a aproximadamente $21.000–$23.000 — antes de la estación de trabajo del centro de mando.

Los diez mejores LLMs abiertos: un análisis detallado

1. DeepSeek V3.2 (685B Total / 37B Activos — MoE)

Desarrollador: DeepSeek | Lanzamiento: Diciembre 2025 | Licencia: MIT

DeepSeek V3.2 se sitúa en la cima de esta lista por una razón que trasciende los benchmarks puros: ofrece posiblemente la mejor ratio de parámetros activos respecto a la capacidad total de cualquier modelo frontier.

Construido sobre la arquitectura Mixture-of-Experts con 685 mil millones de parámetros totales pero solo 37 mil millones activados por token, ofrece rendimiento de razonamiento que compite directamente con gigantes de código cerrado como GPT-4o y Claude Opus — siendo totalmente de peso abierto y licenciado bajo MIT.

Para entender por qué la arquitectura MoE es clave, consulta nuestro artículo Más grande ya no escala: activar solo lo necesario.

En un Quad DGX Spark, el checkpoint cuantizado en FP8 de DeepSeek V3.2 consume aproximadamente 350 GB de memoria a través de cuatro nodos, dejando un margen sustancial para KV-cache y contexto.

El modelo soporta una ventana de contexto de 164K tokens e incluye DeepSeek Sparse Attention (DSA) para un manejo eficiente de contexto largo. Su variante de razonamiento, V3.2-Speciale, empuja los límites aún más con capacidades de cadena de pensamiento mejoradas mediante aprendizaje por refuerzo que compiten directamente con Gemini-3-Pro.

Rendimiento de cuantización:

FP8 retiene más del 98% de las puntuaciones de benchmark a precisión completa. Las variantes 4-bit GPTQ y AWQ están disponibles en Hugging Face, reduciendo la huella de memoria a menos de 200 GB — cómodo incluso en una configuración de tres nodos.

El modelo también está disponible a través de Ollama para un despliegue local simplificado.

Ideal para: Razonamiento empresarial, generación de código, análisis científico y flujos de trabajo agénticos que requieren llamadas a herramientas.

2. Qwen3.5-397B-A17B (397B Total / 17B Activos — MoE)

Desarrollador: Alibaba Cloud (Equipo Qwen) | Lanzamiento: 16 de febrero de 2026 | Licencia: Apache 2.0

La familia Qwen 3.5 es el lanzamiento de código abierto más importante de principios de 2026, y el modelo insignia de 397B es su joya de la corona.

Con 397 mil millones de parámetros totales y solo 17 mil millones activados por paso forward, este modelo utiliza una arquitectura híbrida innovadora que combina Gated Delta Networks (atención lineal) con un diseño Mixture-of-Experts sparse — una primicia en el mundo de peso abierto.

Qwen3.5-397B-A17B es nativamente multimodal, con fusión texto-visión integrada en el pre-entrenamiento en lugar de atornillada mediante codificadores separados. Esto le da un razonamiento espacial superior y precisión OCR comparado con arquitecturas multimodales basadas en pipeline.

Para una visión más profunda de los modelos compactos de Qwen, lee nuestro análisis de Qwen3.5-9B: un modelo compacto con una ventana de contexto masiva.

En benchmarks, puntúa 87,8 en MMLU-Pro y 94,9 en MMLU-Redux, colocándolo firmemente en territorio frontier. Soporta una ventana de contexto nativa de 262K y cubre un extraordinario 201 idiomas y dialectos.

En Quad DGX Spark, el GGUF cuantizado a 4-bit de Qwen3.5-397B requiere aproximadamente 220 GB, distribuyéndose cómodamente en tres nodos.

Una variante Q4 puede ejecutarse en una sola GPU de 24 GB con 256 GB de RAM del sistema usando MoE offloading, alcanzando más de 25 tokens por segundo — pero la arquitectura de memoria unificada del DGX Spark elimina la necesidad de offloading por completo.

Las optimizaciones de terceros de Unsloth proporcionan cuantización GGUF mejorada al elevar las capas críticas a 8 o 16 bits.

Rendimiento de cuantización: La arquitectura MoE + Gated Delta Net demuestra ser notablemente resiliente a la cuantización.

En Q4_K_M, la degradación del rendimiento es inferior al 2,5% en MMLU-Pro. El conteo de 17B parámetros activos significa que la inferencia sigue siendo rápida incluso con pesos cuantizados.

Ideal para: Aplicaciones empresariales multilingües, flujos de trabajo multimodales (texto + visión), seguimiento de instrucciones, matemáticas, codificación y despliegues globales en 201 idiomas.

3. Qwen3.5-122B-A10B (122B Total / 10B Activos — MoE)

Desarrollador: Alibaba Cloud (Equipo Qwen) | Lanzamiento: 24 de febrero de 2026 | Licencia: Apache 2.0

Si el buque insignia de 397B es la artillería pesada, el modelo medio de 122B es el rifle de precisión.

Qwen3.5-122B-A10B activa solo 10 mil millones de parámetros de sus 122 mil millones totales — convirtiéndolo en uno de los modelos de clase frontier más eficientes en cómputo jamás lanzados.

A pesar de activar menos parámetros que muchos modelos de clase 7B, ofrece un rendimiento que frecuentemente supera al antiguo Qwen3-235B e incluso a GPT-5-mini en varias categorías críticas.

Los números hablan por sí solos: 86,7 en MMLU-Pro, 94,0 en MMLU-Redux, 86,6 en GPQA Diamond (vs. 82,8 para GPT-5-mini), 72,2 en BFCL-V4 para tareas agénticas (vs. 55,5 para GPT-5-mini) y 86,2 en MathVision (vs. 71,9).

Como su hermano mayor, es nativamente multimodal con fusión texto-visión temprana, soporta una ventana de contexto de 262K y cubre 201 idiomas.

En Quad DGX Spark, el Qwen3.5-122B cuantizado a 4-bit requiere aproximadamente 70 GB — se ejecuta cómodamente en un solo nodo DGX Spark con un margen masivo para KV-cache e inferencia por lotes.

Esto lo convierte en el modelo secundario ideal en un despliegue multi-modelo, o una potencia independiente para equipos que quieren dedicar su clúster quad completo a otras cargas de trabajo.

Rendimiento de cuantización: Sobresaliente.

La huella de 10B parámetros activos significa que los errores de cuantización tienen efectos en cascada mínimos. En Q4_K_M, la degradación de benchmark es inferior al 2% en todas las evaluaciones principales.

Ideal para: IA empresarial eficiente en costes, tareas de visión multimodal, flujos de trabajo agénticos, razonamiento STEM y como modelo secundario de alto rendimiento en arquitecturas multi-modelo.

4. MiniMax M2.5 (230B Total / 10B Activos — MoE)

Desarrollador: MiniMax (Hailuo AI) | Lanzamiento: 12 de febrero de 2026 | Licencia: Open-weight (uso comercial permitido)

MiniMax M2.5 es el caballo negro de este ranking.

Este modelo MoE nativamente multimodal procesa texto, imágenes, vídeo y audio en un espacio latente unificado — eliminando la latencia de ensamblaje de codificadores que afecta a otras arquitecturas multimodales.

Con solo 10 mil millones de parámetros activos, es uno de los modelos más ligeros de esta lista en términos de cómputo por token, sin embargo puntúa 80,2% en SWE-Bench Verified para codificación e iguala a Claude Opus 4.6 en velocidad de tareas agénticas.

Completa la evaluación de SWE-Bench Verified un 37% más rápido que su predecesor M2.1, y ahorra aproximadamente un 20% en rondas de llamadas a herramientas gracias a una madurez de decisión mejorada.

El modelo soporta una ventana de contexto de 196K tokens (con algunas configuraciones alcanzando aproximadamente 1 millón de tokens) y ha sido entrenado en más de 10 lenguajes de programación.

A $0,295 por millón de tokens de entrada vía API, tiene un precio competitivo — pero por supuesto, ejecutarlo localmente en tu clúster DGX Spark elimina ese coste por completo.

En Quad DGX Spark, la cuantización dinámica de 3-bit (UD-Q3_K_XL) usa aproximadamente 101 GB, haciendo que M2.5 sea ejecutable en un solo nodo.

La variante 8-bit Q8_0 a 243 GB es el despliegue recomendado para calidad de producción, distribuyéndose cómodamente en dos o tres nodos.

Rendimiento de cuantización: La cuantización agresiva de 3-bit es viable gracias al pequeño número de parámetros activos.

La variante de 8-bit es virtualmente indistinguible del modelo a precisión completa en evaluaciones ciegas.

Ideal para: Flujos de trabajo multimodales (texto/imagen/vídeo/audio), tareas de codificación agénticas y aplicaciones interactivas en tiempo real.

5. GLM-5 / GLM-4.7 (355B Total — Híbrido Dense/MoE)

Desarrollador: Zhipu AI | Lanzamiento: Q1 2026 | Licencia: Open-weight

GLM-5 ha emergido como una potencia de razonamiento.

En los rankings de principios de 2026, lidera varios benchmarks de razonamiento frontier, superando a DeepSeek R1 en generación de demostraciones matemáticas y puzzles de lógica multi-paso.

Hemos analizado las capacidades de GLM-5 en detalle en GLM-5: del vibe coding a la ingeniería agentiva.

La arquitectura mezcla componentes densos y MoE en un diseño híbrido que mantiene un rendimiento sólido incluso bajo cuantización agresiva.

Su modelo compañero, GLM-4.7 (355B parámetros totales), está específicamente optimizado para codificación, matemáticas y rendimiento agéntico, alcanzando puntuaciones máximas en los benchmarks HumanEval y AIME 2025.

GLM-4.7 es el caballo de batalla práctico — si GLM-5 es el teórico, GLM-4.7 es el ingeniero.

Su predecesor, GLM-4.5-Air, ganó un seguimiento de culto por ejecutarse suavemente en GPUs de consumo mientras mantenía una calidad impresionante en tareas cotidianas.

En Quad DGX Spark, un GLM-4.7 cuantizado a 4-bit ocupa aproximadamente 200 GB en dos o tres nodos, mientras que GLM-5 a niveles de cuantización similares cabe en 120–150 GB.

Ambos modelos dejan amplio espacio en la configuración quad para servicio multi-modelo o escenarios de contexto largo.

Rendimiento de cuantización: La arquitectura híbrida demuestra ser resiliente a la cuantización.

La puntuación AWQ de 4-bit muestra menos del 2,5% de degradación en MMLU-Pro para ambos modelos.

Ideal para: Razonamiento avanzado, demostraciones matemáticas, agentes de codificación, diálogo multi-turno y tareas de investigación científica.

6. Kimi-K2.5 (1T Total / 32B Activos — MoE)

Desarrollador: Moonshot AI | Lanzamiento: Q4 2025 | Licencia: Open-weight

Kimi-K2.5 está específicamente optimizado para cargas de trabajo agénticas — tareas donde el modelo necesita planificar, ejecutar llamadas a herramientas, buscar en la web, navegar sistemas de archivos e iterar refinando sus outputs.

Con un impresionante billón de parámetros totales y 32 mil millones activos por paso forward, es el modelo más grande de esta lista por conteo total de parámetros.

En benchmarks agénticos como AgentBench y ToolBench, Kimi-K2.5 lidera todos los modelos de peso abierto y se acerca al alcance de Claude Opus en tareas de ejecución multi-paso.

Frecuentemente se clasifica como un modelo de nivel S en encuestas de LLMs auto-alojados, segundo solo después de GLM-5 en algunos rankings.

Su arquitectura MoE está afinada para enrutamiento de baja latencia y soporta llamadas a funciones nativas con output JSON estructurado.

El modelo también soporta enjambres de agentes y ventanas de contexto largo, haciéndolo ideal para escenarios complejos de orquestación multi-agente.

En Quad DGX Spark con cuantización de 4-bit, Kimi-K2.5 consume aproximadamente 280 GB — un ajuste cómodo en tres o cuatro nodos.

Aquí es donde la configuración Quad completa se vuelve esencial: Kimi-K2.5 genuinamente se beneficia del pool completo de memoria de 512 GB para su matriz de pesos de 1T parámetros.

Rendimiento de cuantización: El modelo fue lanzado con variantes cuantizadas oficiales GGUF y GPTQ.

El rendimiento a 4-bit retiene el 95% del original en benchmarks agénticos; a 8-bit retiene el 98%.

Ideal para: Flujos de trabajo agénticos, codificación autónoma, orquestación de uso de herramientas, enjambres de agentes y razonamiento multi-paso con efectos secundarios en el mundo real.

7. MiMo-V2-Flash (309B Total / 15B Activos — MoE)

Desarrollador: Xiaomi | Lanzamiento: 16 de diciembre de 2025 | Licencia: Open-weight

MiMo-V2-Flash es la sorpresa de un rincón inesperado.

Desarrollado por Xiaomi — más conocida por smartphones y electrónica de consumo — este modelo MoE ultra-rápido está construido específicamente para flujos de trabajo agénticos y asistentes de codificación.

Con 309 mil millones de parámetros totales y solo 15 mil millones activos por token, supera a varios modelos más grandes en benchmarks de ingeniería de software mientras mantiene un rendimiento excepcionalmente alto, rivalizando incluso con Claude Sonnet 4.5 en ciertas evaluaciones.

La arquitectura es distintivamente innovadora: cada capa MoE contiene 256 expertos enrutados con 8 activados por token, y el modelo usa un diseño de atención híbrida que intercala Sliding Window Attention (SWA) con Global Attention en una ratio agresiva de 5:1 con una ventana deslizante de 128 tokens.

Un módulo de Multi-Token Prediction (MTP) triplica la velocidad de inferencia para cargas de trabajo compatibles.

La designación "Flash" está bien ganada.

El modelo soporta una ventana de contexto de 256K y un modo "thinking" híbrido para cadenas de razonamiento complejo.

En Quad DGX Spark a cuantización de 4-bit, MiMo-V2-Flash requiere aproximadamente 175 GB — un ajuste cómodo en dos o tres nodos.

Su enrutamiento eficiente y módulo MTP significan que la latencia por token está entre las más bajas de esta lista.

Rendimiento de cuantización: La arquitectura MoE de 256 expertos distribuye el error de cuantización de manera extremadamente efectiva.

A 4-bit, la retención de rendimiento es aproximadamente del 96% en benchmarks de codificación.

Ideal para: Asistencia de codificación de alto rendimiento, flujos de trabajo de ingeniería de software, tareas de desarrollo agéntico e integración con pipelines CI/CD.

8. GPT-OSS-120B (120B — Dense)

Desarrollador: OpenAI | Lanzamiento: Q4 2025 | Licencia: Apache 2.0

El elefante en la habitación.

El primer modelo genuino de peso abierto de OpenAI es un transformer denso de 120 mil millones de parámetros que ofrece una calidad de razonamiento y seguimiento de instrucciones notablemente cercana a GPT-4o.

Lanzado bajo la licencia Apache 2.0 — un movimiento sorpresa que envió ondas de choque por la industria — gpt-oss-120b iguala o supera a muchos modelos propietarios en benchmarks fundamentales.

Aunque carece de la eficiencia de parámetros de las arquitecturas MoE, gpt-oss-120b compensa con pura calidad por token y un ecosistema de recetas de fine-tuning publicadas junto con los pesos.

Una variante más pequeña de 20B también está disponible para desarrollo y pruebas en hardware de consumo.

En Quad DGX Spark, la cuantización GPTQ de 4-bit de gpt-oss-120b requiere aproximadamente 70 GB — haciéndolo uno de los modelos frontier más eficientes en memoria de esta lista.

La variante de 8-bit se sitúa en alrededor de 130 GB.

Esto deja un margen enorme para servicio concurrente, grandes KV-caches y configuraciones de ensamble multi-modelo.

El modelo de 120B puede ejecutarse en una sola GPU de 80 GB, y en DGX Spark está bien dentro del territorio de un solo nodo.

Rendimiento de cuantización: Los modelos densos son inherentemente más sensibles a la cuantización agresiva que las arquitecturas MoE.

Sin embargo, el checkpoint oficial de 4-bit de OpenAI fue entrenado con ajuste consciente de cuantización, y la degradación de benchmark se mantiene por debajo del 4%.

Ideal para: Razonamiento de propósito general, seguimiento de instrucciones, escritura creativa y escenarios donde quieres la aproximación más cercana a un modelo OpenAI alojado en la nube ejecutándose completamente en tu propio hardware.

9. Mixtral 8x22B (141B Total / ~39B Activos — MoE)

Desarrollador: Mistral AI | Lanzamiento: 17 de abril de 2024 | Licencia: Apache 2.0

Mixtral 8x22B es el decano del movimiento MoE de código abierto.

El nombre describe la arquitectura directamente: 8 grupos de expertos de aproximadamente 22 mil millones de parámetros cada uno, con 2 expertos activados por token, produciendo aproximadamente 39 mil millones de parámetros activos de un total de 141 mil millones.

Lanzado bajo Apache 2.0 — la licencia de código abierto más permisiva — fue un modelo hito cuando se lanzó en abril de 2024 y sigue siendo notablemente competitivo casi dos años después.

Los propios benchmarks de Mistral muestran que supera a todos los modelos densos de clase 70B mientras se ejecuta más rápido, gracias a su patrón de activación sparse.

La madurez del modelo es una ventaja genuina.

Miles de variantes fine-tuned existen en Hugging Face, cubriendo dominios desde análisis legal hasta respuestas a preguntas médicas.

El ecosistema de cuantización es igualmente profundo: formatos GGUF, GPTQ, AWQ y ExLlamaV2 están todos disponibles en cada ancho de bits concebible.

El hermano mayor de Mistral, Mistral Large 3 (675B MoE, contexto 256K), también está disponible como modelo de nivel A para despliegues auto-alojados, pero sus requisitos de memoria lo empujan más allá del territorio cómodo de quad-nodo en niveles de cuantización más altos.

En Quad DGX Spark a cuantización de 4-bit, Mixtral 8x22B requiere aproximadamente 80 GB — una huella ligera que lo hace ideal para servicio multi-modelo junto a un modelo primario más grande.

Rendimiento de cuantización: Excelente.

El mecanismo de enrutamiento de 8 expertos distribuye el error de cuantización entre los expertos, resultando en menos del 2% de degradación en Q4_K_M.

Ideal para: Despliegues comerciales que requieren una licencia permisiva, especialización de dominio vía fine-tuning y arquitecturas de ensamble multi-modelo.

10. Qwen3.5-27B (27B — Dense)

Desarrollador: Alibaba Cloud (Equipo Qwen) | Lanzamiento: 24 de febrero de 2026 | Licencia: Apache 2.0

El Qwen3.5-27B es el peso pesado denso de la familia Qwen 3.5 — y la máquina definitiva de seguimiento de instrucciones.

Con 27 mil millones de parámetros sin overhead de enrutamiento MoE, alcanza un extraordinario 95,0 en IFEval y 76,5 en IFBench para seguimiento de instrucciones, convirtiéndolo en el modelo con mayor puntuación de toda la línea Qwen 3.5 en output estructurado y tareas complejas de instrucciones multi-paso.

Esto lo convierte en el modelo de referencia para flujos de trabajo que demandan formateo preciso y predecible: generación de JSON, extracción de datos estructurados, llenado de formularios y ejecución de prompts con múltiples restricciones.

Como sus hermanos MoE, Qwen3.5-27B es nativamente multimodal con fusión texto-visión temprana, soporta una ventana de contexto de 262K, cubre 201 idiomas y se beneficia del mismo pipeline de entrenamiento con Scaled Reinforcement Learning.

Pero a diferencia de las variantes MoE, su arquitectura densa significa que cada parámetro participa en cada paso forward — produciendo latencia y comportamiento consistentemente predecibles en los que los pipelines empresariales confían.

En Quad DGX Spark, el Qwen3.5-27B cuantizado a 4-bit requiere aproximadamente 16 GB — haciéndolo el modelo más ligero de esta lista por un amplio margen.

Podrías ejecutar ocho instancias en un solo nodo DGX Spark.

Esto lo convierte en el modelo utilitario definitivo: un respondedor rápido y ligero para enrutamiento, clasificación, extracción estructurada y sub-tareas de agentes mientras los modelos más pesados manejan el razonamiento complejo.

Rendimiento de cuantización: Sobresaliente.

A 4-bit, Qwen3.5-27B retiene más del 97% de sus puntuaciones de benchmark a precisión completa. Su pequeño conteo de parámetros significa que los errores de cuantización tienen menos efectos en cascada.

Ideal para: Seguimiento de instrucciones, generación de output estructurado, extracción de JSON/datos, clasificación multilingüe, enrutamiento de agentes y como "primer respondedor" rápido en arquitecturas multi-modelo.

Panorama de la competencia: el paisaje de peso abierto en 2026

Los diez modelos anteriores fueron seleccionados de un campo que nunca ha sido más denso ni más competitivo.

Entender el paisaje más amplio ayuda a contextualizar por qué estos diez destacan.

La revolución MoE

El tema abrumador de 2025–2026 es el dominio de las arquitecturas Mixture-of-Experts.

Siete de los diez modelos en esta lista usan MoE (o MoE híbrido), y con razón: al activar solo una fracción del total de parámetros por token, los modelos MoE alcanzan calidad de clase frontier a una fracción del coste de inferencia de los modelos densos.

Para una comprensión profunda de por qué "más grande" ya no es la respuesta, lee Más grande ya no escala: activar solo lo necesario.

Para el despliegue local en hardware con memoria restringida como el DGX Spark, esta elección arquitectónica es decisiva.

Un modelo MoE de 685B que activa 37B parámetros no es solo más barato de ejecutar que un hipotético modelo denso de 685B — es físicamente posible ejecutarlo localmente, mientras que el equivalente denso requeriría aproximadamente 1,3 TB de memoria a cuantización de 4-bit.

La innovación Gated Delta Network

Qwen 3.5 introdujo un elemento arquitectónico genuinamente novedoso: las Gated Delta Networks, que reemplazan o aumentan la atención cuadrática tradicional con mecanismos de atención lineal.

Esto permite que el modelo de 397B alcance costes de inferencia más cercanos a un modelo denso de 17B mientras retiene la calidad de un modelo de órdenes de magnitud mayor.

Espera que esta innovación arquitectónica se propague rápidamente por la industria en la segunda mitad de 2026.

La ola china de código abierto

Los laboratorios de IA de China han remodelado fundamentalmente el paisaje de LLMs de código abierto.

DeepSeek, Alibaba (Qwen — con tres modelos en este top diez solo), Zhipu AI (GLM), Moonshot AI (Kimi), MiniMax y Xiaomi (MiMo) ocupan colectivamente siete de este top diez — una mayoría contundente.

Sus modelos se lanzan uniformemente bajo licencias permisivas, frecuentemente con soporte de cuantización completo desde el primer día, y en muchos casos con costes de entrenamiento que son una fracción de sus contrapartes occidentales.

DeepSeek V3, por ejemplo, fue reportadamente entrenado por aproximadamente $5,6 millones — un orden de magnitud menos que modelos occidentales comparables.

El ecosistema de cuantización

Las herramientas para inferencia cuantizada han madurado dramáticamente.

- llama.cpp sigue siendo el motor de inferencia fundamental, ahora con soporte de primera clase para cuantización de 2-bit, 3-bit, 4-bit, 5-bit, 6-bit y 8-bit en formatos GGUF y GPTQ.

- vLLM ha emergido como el estándar de oro para servicio en producción, con paged attention y batching continuo que permiten despliegues multi-modelo de alto rendimiento.

- Ollama proporciona el camino de entrada más simple posible — un solo comando para descargar y ejecutar cualquier modelo con una API compatible con OpenAI.

- LM Studio añade una interfaz gráfica pulida para usuarios no técnicos.

- Text-generation-webui (Oobabooga) ofrece la configurabilidad más profunda para usuarios avanzados.

- Unsloth se ha vuelto indispensable para cuantización GGUF optimizada, particularmente para modelos Qwen 3.5.

Omisiones notables

Varios modelos fuertes quedaron fuera de esta lista por poco.

- Gemma 3 27B de Google DeepMind es sobresaliente para su clase de tamaño pero fue superado por las puntuaciones superiores de seguimiento de instrucciones del Qwen3.5-27B y su cobertura de 201 idiomas.

- Command A (111B, Cohere, marzo 2025) destaca en RAG empresarial con citas nativas pero su licencia CC-BY-NC es más restrictiva que los modelos Apache 2.0 que dominan esta lista.

- Command R+ (104B, Cohere) fue un pionero en RAG pero ha sido oficialmente superado por Command A.

- Llama 3.3 70B Instruct sigue siendo un modelo de propósito general capaz, aunque ha sido superado por arquitecturas más nuevas.

- Falcon 180B ha perdido terreno frente a diseños MoE más eficientes.

- Yi-Lightning de 01.AI y Jamba 1.5 de AI21 Labs son prometedores pero carecen del ecosistema de cuantización completo del top diez.

- Phi-4 de Microsoft es excepcional para su clase de tamaño pero cae fuera del alcance frontier de este análisis.

- Arcee AI Trinity Large (400B MoE, 13B activos) es un entrante prometedor de enero de 2026 que merece vigilancia.

El centro de mando: eligiendo el mejor sistema para gestionar tu clúster Quad DGX Spark

Ejecutar cuatro nodos DGX Spark demanda una estación de trabajo de gestión dedicada — un centro de mando que maneje la orquestación, monitorización, preprocesamiento de datos, gestión de modelos y sirva como la interfaz primaria para desarrolladores y operadores.

Los nodos DGX Spark en sí deberían estar dedicados completamente a cargas de trabajo de inferencia y fine-tuning; descargar las tareas de gestión a una máquina separada asegura el máximo rendimiento.

Requisitos para el centro de mando

- CPU de alto conteo de núcleos para preprocesamiento de datos, orquestación de contenedores y gestión de múltiples sesiones SSH / NCCL.

- RAM sustancial (128 GB mínimo) para manipulación de datasets y procesamiento en memoria.

- Almacenamiento NVMe rápido (Gen 4 / Gen 5) para staging rápido de modelos y gestión de checkpoints.

- Red 10 GbE o más rápida para comunicarse con los nodos DGX Spark a velocidad de línea.

- GPU capaz (opcional pero recomendada) para desarrollo local, pruebas y visualización.

- Soporte Linux (Ubuntu preferido) para compatibilidad con el stack de software NVIDIA AI.

- Memoria ECC para fiabilidad de misión crítica durante operaciones de larga duración.

Stack de software para el centro de mando

- NVIDIA Base Command Manager para orquestación centralizada del clúster y gestión de cargas de trabajo basada en Kubernetes.

- Prometheus + Grafana para monitorización en tiempo real de utilización de GPU, consumo de memoria, latencia de inferencia y rendimiento en los cuatro nodos DGX Spark.

- Ollama o vLLM como servidor de inferencia principal, ejecutándose en los nodos DGX Spark pero gestionado desde el centro de mando.

- Docker + NVIDIA Container Toolkit para despliegue reproducible de modelos.

- Ansible o Terraform para gestión de infraestructura como código de la configuración del clúster.

15 opciones de centro de mando

| Estación de trabajo | Precio estimado | Especificaciones y características |

|---|---|---|

| Dell Precision 7875 Tower | ~$8.000–$10.000 | Threadripper PRO; fiable para tareas empresariales de IA |

| HP Z6 G5 | ~$10.000–$13.000 | Intel Xeon W9-3495X (56 núcleos); alto rendimiento para ciencia de datos |

| Lambda Hyperplane | ~$15.000–$20.000 | Build custom premium; preconfigurado con stack completo NVIDIA AI |

| Lenovo ThinkStation PX | ~$12.000–$18.000 | Dual Intel Xeon W9-3595X (120 núcleos); soporte quad RTX GPU y 2TB DDR5 ECC |

| BOXX APEXX T4 | ~$10.000–$16.000 | AMD Threadripper PRO 9000 (96 núcleos); refrigeración líquida con soporte quad GPU |

| Puget Systems Custom AI | ~$10.000–$18.000 | Threadripper PRO 7995WX o Xeon w7-3565X; construido a mano por carga de trabajo |

| Supermicro Super AI Station | ~$15.000–$25.000 | Intel Xeon 6 SoC; densidad de memoria de servidor (775GB) en formato de escritorio |

| Lenovo ThinkStation P8 | ~$9.000–$14.000 | AMD Threadripper PRO 7995WX; chasis Aston Martin con PSU Platinum 1500W |

| Exxact Valence VWS-264580 | ~$12.000–$20.000 | Dual Xeon/EPYC; enfocado en deep learning con quad RTX GPUs |

| Velocity Micro ProMagix HD150 | ~$11.000–$17.000 | Dual AMD EPYC 9004 (128 núcleos); optimizado para simulaciones masivamente multi-hilo |

| Digital Storm Slade AI | ~$13.000–$19.000 | Intel Xeon W-3400; refrigeración líquida quad GPU para ciclos de trabajo pesados |

| Origin PC L-Class Pro | ~$9.500–$15.000 | AMD Threadripper PRO 7000; 128GB+ ECC RAM; versátil para ciencia de datos |

| Bison Computing AI-4000 | ~$14.000–$22.000 | Dual Intel Xeon Gold; soporta 4x RTX 6000 Ada; Linux empresarial preinstalado |

| System76 Thelio Mega | ~$8.500–$16.000 | AMD Threadripper PRO; firmware de código abierto y stack Pop!_OS AI especializado |

| NextComputing Edge X-TA | ~$12.500–$21.000 | AMD EPYC 9004; formato portátil "transportable" con capacidad 4x GPU para campo |

Desglose de costes: el despliegue completo

| Componente | Cantidad | Coste unitario | Total |

|---|---|---|---|

| NVIDIA DGX Spark | 4 | $4.699 | $18.796 |

| Switch RoCE 200 GbE + Cableado | 1 | ~$3.000 | ~$3.000 |

| Centro de mando | 1 | ~$13.000 | ~$13.000 |

| UPS / Acondicionamiento eléctrico | 1 | ~$1.200 | ~$1.200 |

| Total | ~$35.996 |

Sin embargo, solo equipos pequeños de 5-10 desarrolladores podrán usar este sistema para codificación agéntica como OpenClaw.

Si tu prioridad principal es el presupuesto, ve con modelos en la nube.

Opta por LLMs locales si eres una startup de 1-10 personas y necesitas privacidad de datos a cualquier coste.

Esto NO es económico.

Para un negocio de 1000 personas, necesitas clústeres de 8 H100 con un coste total de 250.000 USD, o un Base-8X-H200-Server con un coste de 400.000 USD.

El mantenimiento, la resolución de problemas, el personal y los costes eléctricos jugarán un papel significativo en el presupuesto.

Recomendaciones prácticas: qué modelos desplegar

Basándonos en este análisis, aquí presentamos una estrategia de despliegue multi-modelo recomendada para Quad DGX Spark:

Modelo de razonamiento principal (Nodos 1–3)

DeepSeek V3.2 a cuantización FP8 (~350 GB a través de tres nodos). Este es tu arma pesada para razonamiento complejo, generación de código y flujos de trabajo agénticos.

Modelo utilitario rápido (Nodo 4)

Qwen3.5-122B-A10B a Q4_K_M (~70 GB) es el modelo utilitario ideal — calidad de clase frontier con huella de un solo nodo. Co-localiza Qwen3.5-27B (~16 GB a Q4) en el mismo nodo para tareas de seguimiento de instrucciones, enrutamiento y extracción estructurada — juntos usan menos de 90 GB, dejando margen en un solo nodo de 128 GB.

Experimentación de fin de semana

Intercambia MiniMax M2.5 para flujos de trabajo multimodales (imagen/vídeo/audio), Kimi-K2.5 para benchmarking agéntico e investigación de enjambres de agentes, o el Qwen3.5-397B para máxima calidad multimodal multilingüe.

Configuración enfocada en codificación

Despliega MiMo-V2-Flash (~175 GB en dos nodos) como tu motor de codificación principal, con GPT-OSS-120B (~70 GB a Q4) en un tercer nodo para razonamiento general, y Qwen3.5-122B (~70 GB) en el cuarto para tareas multilingües y de visión.

Si te interesa cómo elegir el mejor LLM para codificación, consulta Mejor LLM para vibeCoding: comparativa real de velocidad y enfoque.

Esta configuración te da una infraestructura de IA multi-modelo versátil que cubre razonamiento, codificación, multilingüe, multimodal y generación aumentada por recuperación — todo ejecutándose localmente, todo bajo tu control completo.

Conclusión: la era del centro de datos de IA personal

La convergencia de tres fuerzas — modelos frontier de peso abierto, técnicas de cuantización eficientes y hardware de alto rendimiento asequible — ha hecho de 2026 el año en que ejecutar tu propio clúster de LLMs local se volvió viable.

Un despliegue Quad DGX Spark con un centro de mando dedicado te da:

- 512 GB de memoria de IA unificada — suficiente para cualquier modelo de peso abierto existente.

- ~4 petaflops de cómputo FP4 — más que suficiente para inferencia en tiempo real y fine-tuning modesto.

- Soberanía de datos completa — nada sale de tus instalaciones.

- Una arquitectura multi-modelo — ejecuta tres o cuatro modelos simultáneamente para diferentes cargas de trabajo.

Sin embargo, esto no es económico.

No más de 5-10 desarrolladores pueden usar esto intensivamente para casos de uso como OpenClaw.

El único caso de uso es la soberanía de datos.

Úsalo para equipos pequeños que requieran sistemas aislados (air-gapped).

No hay ganancia de presupuesto para un equipo tan pequeño.

Los modelos en esta lista — DeepSeek V3.2, Qwen3.5-397B, Qwen3.5-122B, MiniMax M2.5, GLM-5/GLM-4.7, Kimi-K2.5, MiMo-V2-Flash, gpt-oss-120b, Mixtral 8x22B y Qwen3.5-27B — representan la mejor IA de peso abierto que la humanidad ha producido.

Siempre emplea expertos capacitados y verificados para gestionar y mantener estos sistemas.

Los LLMs frontier necesitan actualizarse cada tres meses para estar al nivel SOTA. Planifica y presupuesta en consecuencia.

Y puedes ejecutar todos ellos en tus sistemas locales con esta arquitectura, con espacio para experimentación.

Con esta configuración, tienes espacio para acomodar las grandes ventanas de contexto que necesitas.

Para entender por qué las ventanas de contexto importan tanto, lee El mito del contexto infinito y Compactación rápida del KV Cache mediante Attention Matching.

Por eso decidí ir con 4 en lugar de 2 NVIDIA DGX Sparks.

Listo para el futuro con modelos más grandes — y mucho espacio para ventanas de contexto. (nota: plural)

Bienvenido al centro de datos de IA personal. (Redoble de tambor, por favor)

Referencias y lecturas adicionales

- NVIDIA. "DGX Spark — Personal AI Supercomputer." nvidia.com, 2025.

- NVIDIA. "ConnectX-7 SmartNIC Specifications." nvidia.com, 2025.

- NVIDIA. "DGX Spark Founders Edition Price Revision." nvidia.com, 27 de febrero de 2026.

- DeepSeek. "DeepSeek-V3.2 Technical Report." deepseek.com, diciembre 2025.

- Alibaba Cloud / Qwen Team. "Qwen3.5 Model Family." qwen.ai, febrero 2026.

- Alibaba Cloud / Qwen Team. "Qwen3.5-122B-A10B." huggingface.co/Qwen, febrero 2026.

- MiniMax. "M2.5: Natively Multimodal Intelligence." huggingface.co/MiniMax, febrero 2026.

- Zhipu AI. "GLM-5 / GLM-4.7 Technical Overview." zhipuai.cn, 2026.

- Moonshot AI. "Kimi-K2.5: Agentic Intelligence at 1T Parameters." moonshot.cn, 2025.

- Xiaomi. "MiMo-V2-Flash: Ultra-Fast MoE for Coding." mi.com, diciembre 2025.

- OpenAI. "gpt-oss-120b Open Weights Release (Apache 2.0)." openai.com, 2025.

- Mistral AI. "Cheaper, Better, Faster, Stronger — Mixtral 8x22B." mistral.ai, 17 de abril de 2024.

- Alibaba Cloud / Qwen Team. "Qwen3.5-27B Dense Model." huggingface.co/Qwen, febrero 2026.

- Ollama. "Local Model Deployment Guide." ollama.com, 2025.

- vLLM Project. "High-Throughput LLM Serving." vllm.ai, 2025.

- Unsloth. "Optimised GGUF Quantisation for Qwen 3.5." unsloth.ai, 2026.

- NVIDIA. "Base Command Manager for AI Clusters." nvidia.com, 2025.

- NVIDIA. "Introduction to the NVIDIA DGX Station A100." nvidia.com, 2025.

Apéndice A: Problemas en producción y mitigaciones

Desplegar un clúster Quad DGX Spark para inferencia local de LLMs es un reto fundamentalmente diferente a ejecutar un modelo en un laboratorio o para experimentación.

Los entornos de producción demandan tiempo de actividad sostenido, latencia predecible, integridad de datos y degradación elegante ante fallos.

Este apéndice cataloga los problemas más significativos que tu despliegue probablemente encontrará en producción y proporciona mitigaciones accionables para cada uno.

¡Y este sistema puede manejar solo 5-10 desarrolladores usando sistemas de codificación agéntica como OpenClaw!

A1. Throttling térmico y reinicios espontáneos

El problema:

El DGX Spark empaqueta un petaflop de cómputo FP4 en un chasis de 150 × 150 × 50,5 mm refrigerado por un diseño pasivo/asistido por ventilador con cámara de vapor y heat pipes.

Bajo cargas de inferencia sostenidas — particularmente con modelos densos grandes o modelos MoE de contexto largo que mantienen todos los expertos activos — se ha observado throttling térmico, con algunas unidades cayendo de su envolvente de diseño de 240W a 100W o menos.

En casos extremos, el estrés térmico prolongado puede causar reinicios espontáneos, matando las solicitudes de inferencia en vuelo.

Mitigaciones:

- Asegurar flujo de aire adecuado. No apiles las unidades DGX Spark directamente una encima de otra. Usa una bandeja de rack o soporte abierto con al menos 50 mm de separación en todos los lados. Apunta un ventilador de escritorio de bajo ruido a través de las unidades si están en un gabinete cerrado.

- Controlar la temperatura ambiente. Mantén la sala a 24°C (75°F) o menos. Una unidad mini-split dedicada o un AC portátil para el área de servidores es una inversión que vale la pena.

- Monitorizar térmicas proactivamente. Usa

nvidia-smio exportadores Prometheus para rastrear las temperaturas de unión y punto caliente de la GPU. Configura alertas Grafana a 85°C (advertencia) y 92°C (crítico). - Escalonar cargas de trabajo pesadas. Si ejecutas inferencia por lotes o fine-tuning, programa los trabajos más intensivos en cómputo durante horas más frescas (nocturnas) o escálonálos entre nodos para evitar que las cuatro unidades alcancen el pico térmico simultáneamente.

- Limpiar la caché del sistema de archivos periódicamente. NVIDIA Support recomienda ejecutar

sudo sync && echo 3 | sudo tee /proc/sys/vm/drop_caches > /dev/nullpara reclamar memoria y reducir la carga del sistema en segundo plano que puede agravar los problemas térmicos.

A2. Errores de memoria y la ausencia de ECC

El problema:

El DGX Spark usa memoria LPDDR5x unificada compartida entre la GPU y la CPU.

Críticamente, esta memoria no cuenta con Error-Correcting Code (ECC).

En una GPU de centro de datos tradicional como la A100 o H100, el ECC corrige silenciosamente errores de un solo bit y señala errores de múltiples bits antes de que corrompan el cómputo.

Sin ECC, un solo bit flip inducido por rayos cósmicos o una celda de memoria marginal puede corromper silenciosamente los pesos del modelo en memoria, llevando a una calidad de output sutilmente degradada, inestabilidad numérica durante la inferencia o fallos directos de la aplicación — sin rastro diagnóstico apuntando a la causa raíz.

Mitigaciones:

- Implementar capas de validación de output. Para aplicaciones de misión crítica, ejecuta un modelo de verificación ligero (ej. Qwen3.5-27B en un nodo separado) para verificar cruzadamente los outputs del modelo primario buscando anomalías, completaciones incoherentes o basura numérica.

- Programar recargas periódicas del modelo. Reinicia los servidores de inferencia cada 24–48 horas para recargar los pesos del modelo desde disco, limpiando cualquier corrupción de memoria acumulada. Automatiza esto con un cron job y un script de reinicio rodante que ponga los nodos offline de uno en uno.

- Usar almacenamiento de modelos con checksums. Almacena los checkpoints de modelos cuantizados en ZFS o Btrfs con checksums habilitados. Verifica la integridad del archivo con hashes SHA-256 antes de cada carga de modelo.

- Monitorizar síntomas de corrupción silenciosa. Vigila picos inexplicados en puntuaciones de perplejidad, cambios repentinos en distribuciones de longitud de output o aumentos en respuestas "sin sentido" reportadas por usuarios. Estos pueden indicar corrupción a nivel de bit en los pesos cargados.

- Aceptar el trade-off conscientemente. Para la mayoría de cargas de trabajo de inferencia, la probabilidad estadística de que un error de memoria afecte significativamente el output es baja. El ECC es innegociable para entrenamiento (donde la acumulación de gradientes amplifica errores), pero para inferencia, el riesgo es manejable con las mitigaciones anteriores.

A3. Fallos de comunicación NCCL entre nodos

El problema:

La NVIDIA Collective Communications Library (NCCL) orquesta la comunicación GPU entre nodos para inferencia distribuida vía paralelismo de pipeline.

Los fallos de NCCL son una de las clases de errores más comunes — y más frustrantes — en despliegues GPU multi-nodo.

Los síntomas incluyen cuelgues de inferencia (el modelo parece congelarse a mitad de generación), errores de timeout crípticos, rendimiento asimétrico entre pares de nodos y alertas ocasionales de "conexión fallida" que pueden o no indicar fallos reales.

Mitigaciones:

- Fijar la interfaz de red. Establece

NCCL_SOCKET_IFNAME=eth0(o el nombre real de tu interfaz RoCE) para prevenir que NCCL intente usar Wi-Fi, loopback u otras interfaces incorrectas. - Asegurar paridad de versiones. Los cuatro nodos DGX Spark deben ejecutar versiones idénticas de DGX OS, CUDA Toolkit, NCCL y drivers de GPU. Incluso discrepancias menores de versión (ej. NCCL 2.19.3 vs. 2.19.4) pueden causar fallos sutiles de interoperabilidad. Usa Ansible para imponer consistencia de versiones.

- Habilitar logging verboso para diagnóstico. Establece

NCCL_DEBUG=INFO(oNCCL_DEBUG=TRACEpara depuración profunda) para capturar logs de comunicación detallados. Envíalos a un agregador de logs centralizado en el centro de mando. - Aumentar los valores de timeout. El timeout predeterminado de NCCL frecuentemente es demasiado agresivo para fabrics basados en Ethernet. Establece

NCCL_TIMEOUT=600(10 minutos) y ajusta los timeouts detorch.distributedde manera similar. - Ejecutar nccl-tests regularmente. Programa benchmarks semanales de

all_reduce_perfyall_gather_perfen los cuatro nodos. Almacena los resultados en una base de datos de series temporales y alerta ante cualquier regresión de rendimiento que exceda el 10%. - Ignorar alertas benignas de "conexión fallida". NVIDIA ha reconocido que los clústeres DGX Spark pueden emitir mensajes espurios de "conexión fallida" incluso cuando las conexiones tienen éxito. Valida con pruebas de rendimiento reales en lugar de depender exclusivamente de alertas a nivel de log.

A4. Inestabilidad del fabric de red RoCE

El problema:

El fabric RoCE (RDMA over Converged Ethernet) de 200 GbE que conecta los cuatro nodos DGX Spark es la columna vertebral del clúster.

A diferencia de InfiniBand — que es inherentemente sin pérdidas — RoCE se ejecuta sobre Ethernet estándar y requiere una configuración cuidadosa de Priority Flow Control (PFC) y Explicit Congestion Notification (ECN) para lograr un comportamiento sin pérdidas.

Un PFC mal configurado puede causar bloqueo head-of-line, pérdida de paquetes, tormentas de congestión y picos de latencia que se manifiestan como ralentizaciones intermitentes de inferencia o timeouts de NCCL.

Mitigaciones:

- Configurar PFC y ECN correctamente en el switch. Habilita PFC en la clase de prioridad usada por el tráfico RoCE (típicamente prioridad 3 o 4) y configura ECN con umbrales de marcado apropiados. Sigue la guía de configuración RoCEv2 específica de tu proveedor de switch.

- Habilitar tramas jumbo end-to-end. Establece MTU a 9000 en todas las interfaces de red de los DGX Spark, los puertos del switch y la NIC del centro de mando. Configuraciones MTU inconsistentes causan fragmentación, retransmisiones y degradación severa del rendimiento. Verifica con

ping -M do -s 8972 <target_ip>. - Instalar los últimos drivers MLNX_OFED. El stack de drivers Mellanox OFED de NVIDIA incluye correcciones críticas de rendimiento y estabilidad para NICs ConnectX-7. Actualiza trimestralmente.

- Usar VLANs dedicadas. Aísla el tráfico RoCE en su propia VLAN para prevenir interferencia del tráfico de gestión, sesiones SSH o tráfico de descarga de modelos que comparten la misma red.

- Monitorizar con ibdiagtools. Usa

ibv_devinfopara verificar el estado del dispositivo RDMA eibv_rc_pingpongpara probar la latencia RDMA punto a punto entre cada par de nodos. Alerta ante latencia que exceda 10 µs.

A5. Degradación por cuantización en producción

El problema:

Los modelos cuantizados son el alma de la inferencia local — sin cuantización, la mayoría de los modelos frontier no cabrían en el pool de memoria de 512 GB del Quad DGX Spark.

Sin embargo, la cuantización es una técnica de compresión con pérdida. En el entorno controlado de la evaluación de benchmarks, una degradación del 2–4% a Q4 parece aceptable.

En producción, esa degradación puede manifestarse de manera impredecible: las tasas de alucinación aumentan, el output JSON estructurado se rompe más frecuentemente, la precisión del razonamiento matemático cae en casos límite y el rendimiento multilingüe se degrada más para idiomas de bajos recursos que para los de altos recursos.

Para una comprensión profunda de los fundamentos matemáticos detrás de los LLMs y la cuantización, consulta Fundamentos matemáticos de un LLM: de tokens a Transformers.

Mitigaciones:

- Usar el nivel de cuantización más alto viable. Prefiere FP8 o Q8_0 sobre Q4_K_M siempre que la memoria lo permita. Los ahorros marginales de memoria de pasar de 8-bit a 4-bit rara vez compensan la pérdida de calidad en producción.

- Hacer benchmarks en tu carga de trabajo real, no en benchmarks públicos. Crea un conjunto de evaluación privado de 200–500 prompts representativos de tu tráfico de producción. Mide tasas de aprobación, validez de output estructurado y puntuaciones de preferencia humana en cada nivel de cuantización antes de desplegar.

- Usar cuantizaciones optimizadas de Unsloth. Para modelos Qwen 3.5 en particular, las cuantizaciones GGUF de Unsloth elevan las capas críticas de atención y router a mayor precisión, preservando la calidad donde más importa.

- Implementar monitorización de regresión de calidad. Registra una muestra aleatoria del 1–5% de las solicitudes y respuestas de producción. Ejecuta evaluaciones de calidad automatizadas semanalmente contra esta muestra y alerta si las puntuaciones caen por debajo de la línea base.

- Considerar servicio de precisión híbrida. Algunos motores de inferencia soportan inferencia de precisión mixta donde las capas de atención se ejecutan en FP16 mientras las capas feedforward se ejecutan en INT4. Esto recupera gran parte de la pérdida de calidad a un coste mínimo de memoria.

A6. Inestabilidad del servicio de modelos (Ollama y vLLM)

El problema:

Tanto Ollama como vLLM — los dos servidores de inferencia más populares para despliegue local de LLMs — tienen problemas de estabilidad documentados bajo carga de producción sostenida.

Se ha reportado que Ollama se cuelga después de secuencias de solicitudes extendidas en Linux, requiriendo reinicios periódicos.

vLLM puede encontrar errores de falta de memoria durante la expansión del KV-cache bajo tráfico a ráfagas, cuelgues durante descargas de modelos y diferencias sutiles de calidad de generación dependiendo de la configuración de batching.

Mitigaciones:

- Usar un supervisor de procesos. Ejecuta Ollama o vLLM bajo systemd con

Restart=alwaysyWatchdogSec=120. Esto asegura reinicio automático después de cuelgues o crashes. - Implementar endpoints de health-check. Configura tu reverse proxy (Nginx o Caddy) para sondear el endpoint

/healthcada 30 segundos. Si tres verificaciones consecutivas fallan, dispara un reinicio y alerta. - Establecer límites de memoria explícitamente. Para vLLM, configura

--gpu-memory-utilization 0.85para reservar un 15% de la memoria GPU como margen para picos de KV-cache. Para Ollama, estableceOLLAMA_MAX_LOADED_MODELSpara prevenir sobre-suscripción de memoria. - Habilitar cola de solicitudes. Usa una cola de mensajes (Redis, RabbitMQ) o un gateway (LiteLLM, Portkey) delante del servidor de inferencia para absorber ráfagas de tráfico en lugar de abrumar al servidor de modelos directamente.

- Programar reinicios de mantenimiento. Incluso con supervisión de procesos, programa un reinicio limpio de todos los servidores de inferencia durante una ventana de bajo tráfico diaria (ej. 03:00 hora local) para limpiar la fragmentación de memoria acumulada y recursos filtrados.

A7. Fallos de suministro eléctrico

El problema:

Un clúster Quad DGX Spark con una estación de trabajo de centro de mando consume aproximadamente 1.200–1.500W a carga máxima.

Interrupciones eléctricas — incluso caídas momentáneas de 50–100 ms — pueden crashear los cuatro nodos simultáneamente, corromper checkpoints de modelos siendo escritos a disco y dejar el clúster en un estado inconsistente que requiere recuperación manual.

Mitigaciones:

- Desplegar un UPS calificado para al menos 2.000 VA / 1.600W. Un UPS online (doble conversión) proporciona energía limpia y acondicionada con conmutación sin interrupciones durante cortes. Presupuesta $800–$1.500 para una unidad de calidad de APC, CyberPower o Eaton.

- Configurar NUT (Network UPS Tools) en el centro de mando. NUT monitoriza el UPS vía USB y puede disparar un apagado ordenado de los cuatro nodos DGX Spark vía SSH cuando la batería alcance el 20% restante.

- Usar protectores contra sobretensiones en cada conexión eléctrica. Incluso con un UPS, usa supresores de sobretensión de grado hospitalario en todas las tomas que alimentan el clúster.

- Circuitos separados. Si es posible, ejecuta el clúster en un circuito dedicado de 20A para evitar compartir con aparatos de alto consumo (compresores de aire acondicionado, calentadores) que pueden causar caídas de voltaje.

A8. Cuellos de botella de almacenamiento y retrasos en staging de modelos

El problema:

Intercambiar modelos en un clúster Quad DGX Spark significa cargar 100–400 GB de pesos cuantizados desde almacenamiento NVMe a memoria unificada.

Incluso con SSDs NVMe Gen 4 (velocidades de lectura secuencial de ~7 GB/s), cargar un modelo de 350 GB toma aproximadamente 50 segundos por nodo — y esto asume que los datos están en almacenamiento local.

Si los modelos se transfieren desde el centro de mando por 10 GbE (rendimiento efectivo ~1,1 GB/s), la misma transferencia toma más de cinco minutos. Durante la carga del modelo, el nodo no está disponible para inferencia.

Mitigaciones:

- Pre-staging de modelos en NVMe local. Mantén tus modelos más usados en el SSD local de cada nodo. Usa rsync o un playbook simple de Ansible para enviar archivos de modelo actualizados a todos los nodos en paralelo durante horas de bajo uso.

- Implementar caché de modelos. Configura tu servidor de inferencia para mantener los modelos usados recientemente en memoria y solo expulsarlos cuando la presión de memoria lo demande. Ollama hace esto por defecto; vLLM requiere configuración explícita.

- Usar 200 GbE para transferencias de modelos, no 10 GbE. Si tu switch y NICs lo soportan, enruta las transferencias grandes de modelos por el fabric RoCE en lugar de la red de gestión. Esto reduce los tiempos de transferencia en 20×.

- Adoptar actualizaciones rodantes de modelos. Al desplegar una nueva versión de modelo, actualiza un nodo a la vez mientras los tres restantes continúan sirviendo tráfico. Esto mantiene la disponibilidad durante las transiciones.

A9. Riesgos de seguridad y exfiltración de datos

El problema:

Una de las motivaciones principales para el despliegue local de LLMs es la soberanía de datos — mantener los datos sensibles fuera de las APIs en la nube.

Sin embargo, un clúster local es tan seguro como su configuración de red.

Los nodos DGX Spark vienen con Wi-Fi 7, Bluetooth y puertos USB habilitados por defecto.

Un nodo mal configurado podría exponer inadvertidamente endpoints de inferencia a la red local, filtrar datos vía consultas DNS o ser comprometido a través de una dependencia no parcheada en el stack de software.

Mitigaciones:

- Deshabilitar Wi-Fi y Bluetooth en todos los nodos DGX Spark. Usa

nmcliosystemctlpara deshabilitar las interfaces inalámbricas permanentemente. Estos nodos deberían comunicarse exclusivamente por el fabric RoCE cableado y Ethernet de gestión. - Aplicar firewall a todos los nodos. Configura

ufwoiptablespara permitir conexiones entrantes solo desde la dirección IP del centro de mando. Bloquea todo otro tráfico entrante. - Aislar (air-gap) la red de inferencia. El switch RoCE de 200 GbE no debería estar conectado a tu LAN corporativa ni a internet. Las descargas de modelos y actualizaciones de software deberían realizarse a través del centro de mando, que actúa como host bastión.

- Deshabilitar almacenamiento masivo USB. Previene la exfiltración de datos vía USB deshabilitando el módulo del kernel

usb_storagey bloqueando físicamente los puertos USB no necesarios. - Auditorías de seguridad regulares. Programa escaneos trimestrales de vulnerabilidades de todos los nodos y el centro de mando. Mantén todos los paquetes actualizados y monitoriza los CVEs relacionados con el stack NVIDIA AI.

Apéndice B: Guía de configuración de red para el clúster Quad

Este apéndice proporciona instrucciones paso a paso para configurar el fabric de red RoCE de 200 GbE que conecta los cuatro nodos DGX Spark.

B1. Topología de red recomendada

[Centro de Mando] ──── 10 GbE ──── [Switch Gestión]

│

[DGX Spark 1] ── 200 GbE ──┐ │

[DGX Spark 2] ── 200 GbE ──┤── [Switch RoCE 200 GbE]

[DGX Spark 3] ── 200 GbE ──┤

[DGX Spark 4] ── 200 GbE ──┘B2. Configuración del switch

- Habilitar PFC en las prioridades 3 y 4

- Configurar ECN con umbrales de marcado apropiados

- Establecer MTU 9000 en todos los puertos

- Crear VLAN dedicada para tráfico RoCE

- Habilitar RoCEv2 y DSCP mapping

B3. Configuración de los nodos

bash

# Establecer MTU en la interfaz RoCE

sudo ip link set eth1 mtu 9000

# Verificar conectividad RDMA

ibv_devinfo

ibv_rc_pingpong -d mlx5_0 -g 1 <peer_ip>

# Configurar NCCL

export NCCL_SOCKET_IFNAME=eth1

export NCCL_IB_GID_INDEX=3

export NCCL_NET_GDR_LEVEL=5

export NCCL_TIMEOUT=600B4. Verificación del clúster

bash

# Test de rendimiento all-reduce entre 4 nodos

mpirun -np 4 --host spark1,spark2,spark3,spark4 \

./all_reduce_perf -b 1M -e 1G -f 2 -g 1El rendimiento esperado debería superar 150 Gbps de ancho de banda bidireccional entre cualquier par de nodos.

Apéndice C: Guía de resolución de problemas rápida

| Síntoma | Causa probable | Acción inmediata |

|---|---|---|

| Inferencia se congela a mitad de generación | Timeout NCCL | Aumentar NCCL_TIMEOUT; verificar MTU consistente |

| Output es basura o incoherente | Corrupción de memoria (no-ECC) | Recargar pesos del modelo desde disco; verificar checksums |

| Rendimiento degrada gradualmente | Throttling térmico | Verificar temperaturas con nvidia-smi; mejorar flujo de aire |

| Nodo se reinicia espontáneamente | Sobrecalentamiento o inestabilidad eléctrica | Verificar UPS; reducir carga en el nodo; verificar PSU |

| Error "connection failed" en logs | Frecuentemente benigno en DGX Spark | Verificar rendimiento real con nccl-tests; ignorar si el rendimiento es normal |

| OOM durante inferencia | KV-cache excede la memoria disponible | Reducir max_seq_len; usar cuantización más agresiva; distribuir en más nodos |

| Latencia alta entre nodos | PFC/ECN mal configurados | Verificar configuración del switch; habilitar tramas jumbo |

| Modelo tarda mucho en cargar | Transferencia por red 10 GbE | Usar NVMe local o transferir por fabric RoCE de 200 GbE |